הסיכון החדש: כשה-AI טועה – ואין אשמה אנושית

מערכות AI עשויות:

- לאבחן שגוי חולה, בלי התערבות רופא

- לשלוט ברכב אוטונומי שמתנגש בגלל "הבנה שגויה" של הסביבה

- לייעץ השקעות מסוכנות לצרכן

- או לפעול על בסיס מידע שגוי בגלל "הרעלת נתונים" (Data Poisoning)

אירועים כאלה לא תמיד נופלים תחת הגדרות הביטוח המסורתיות – לא אחריות מקצועית קלאסית, לא ביטוח מוצר, ולעיתים גם לא ביטוח סייבר. נוצר ואקום ביטוחי – והנזק, לעיתים, עצום.

ביטוח AI – למה הפוליסות הרגילות לא תמיד מספיקות?

- ביטוח סייבר נועד לאירועי פריצה – אך מה אם לא הייתה חדירה, אלא טעות פנימית של האלגוריתם?

- ביטוח אחריות מקצועית מכסה רשלנות – אך לא תמיד תכסה החלטה שגויה שמבוססת על למידת מכונה.

- ביטוח אחריות מוצר תחריג לרוב תקלות תוכנה מורכבות – במיוחד כשהן מבוססות על התנהגות "בלתי צפויה".

פתרונות ביטוח חדשניים – ביטוח AI

בשנים האחרונות מתפתחות פוליסות ייעודיות שנבנו במיוחד עבור סיכוני בינה מלאכותית. אנו מציעים פתרונות מתקדמים המכסים תרחישים שבעבר נחשבו ל"שטח אפור" ביטוחי – כולל טעויות של מודלים אלגוריתמיים, סטיות בלתי צפויות בהתנהגות מערכות אוטונומיות, והחלטות שגויות של כלים מבוססי AI.

בנוסף, אנו מספקים כיסויים למשתמשים עסקיים בשירותי AI בענן, כולל הרחבות לאובדן הכנסות, נזקים לצד שלישי, וליקויים בשירותים אלגוריתמיים – כחלק ממענה כולל לסיכונים החדשים של עידן הבינה המלאכותית.

רכיבי כיסוי עיקריים בביטוח AI

פוליסה חכמה לעולם של אלגוריתמים לומדים

בעידן שבו מערכות בינה מלאכותית מקבלות החלטות אוטונומיות, נדרש ביטוח שיודע להתמודד עם כשלי קוד, סטיות בהתנהגות המודל, והשלכות משפטיות של החלטות שגויות. להלן הרכיבים המרכזיים שמומלץ לכלול בפוליסת ביטוח AI – מבוססים על פרקטיקות עדכניות בשוק האמריקאי והאירופי:

- כשלים אלגוריתמיים (Algorithmic Errors):

כיסוי לנזקים הנובעים מהחלטה שגויה או בלתי צפויה של מערכת AI שפעלה ללא תקלה טכנית אך יצרה תוצאה מזיקה – לדוגמה, מערכת ניתוח רפואי שבוחרת טיפול שגוי או אלגוריתם דירוג אשראי שפוגע בלקוח ללא הצדקה. - מתקפות מכוונות על המודל (Adversarial Attacks):

מימון עלויות הקשורות למתקפות חיצוניות על מודל ה-AI – בהן תוקף משנה את קלטי המידע כדי להטעות את האלגוריתם. לדוגמה: שינוי זעיר בתמונה שגורם לרכב אוטונומי "לחשוב" שזו תמרור אחר. כיסוי כזה הופך חיוני ככל שמודלים משולבים בתשתיות חיוניות. - הטיות והזיות אלגוריתמיות (Bias & Hallucinations):

הגנה מפני תביעות הנובעות מהטיה מגדרית, גזעית או חברתית בקבלת החלטות, וכן "הזיות" – תוצר שגוי או מנותק מהמציאות, במיוחד במודלים גנרטיביים כמו GPT או DALL·E. בארה״ב, כבר היו דיונים משפטיים סביב אפליה אלגוריתמית בקבלה לעבודה ואישור משכנתאות. - שימוש זדוני בטכנולוגיית AI:

כיסוי לנזקים עקיפים או ישירים כתוצאה משימוש לרעה בטכנולוגיית AI של החברה, בין אם על-ידי גורם זדוני חיצוני ובין אם ע״י משתמש לא מורשה. לדוגמה: פרסום דיסאינפורמציה או deepfake שנוצר בעזרת הכלים של החברה ופוגע בצד שלישי. - כיסוי רגולטורי וקנסות (Regulatory & Compliance Costs):

מענה לקנסות והוצאות משפטיות הקשורות להפרת חוקים חדשים, כגון ה-AI Act באירופה או הצעות חוק במדינות כמו קליפורניה וניו יורק, המטילים אחריות על אופן השימוש והאימון של מודלים. כיסוי כזה דומה להרחבות הקיימות כיום תחת GDPR וביטוח סייבר – אך מותאם לסיכוני בינה מלאכותית. - הגנה משפטית (Legal Defense):

עלויות הגנה משפטית כבר משלב האיום, גם אם החברה לבסוף לא נמצאה אחראית. בארה״ב במיוחד, ההוצאות עלולות להיות גבוהות מאוד – גם בתביעות ללא בסיס. - אובדן הכנסות ותיקון מודלים:

הרחבות ייעודיות למקרים שבהם נדרשת השבתה זמנית של שירות או פיתוח מחדש של המודל בעקבות כשל או תקלה חמורה. חשוב לכלול גם הוצאות תקשורת וניהול משבר מול לקוחות ושותפים.

למי מיועד ביטוח AI?

- חברות המפתחות פתרונות AI – כולל SaaS, אלגוריתמים רפואיים, רכבים אוטונומיים ועוד

- חברות המשלבות AI במוצרים קיימים – מערכות תפעול, שליטה או שירות לקוחות

- משתמשי קצה גדולים – בנקים, קמעונאיות או חברות תשתית שמשתמשות ב-AI של ספק צד ג’

- לקוחות ענן ו-AIaaS – שמבקשים לוודא שהשימוש בטכנולוגיה מגובה גם בהגנה ביטוחית

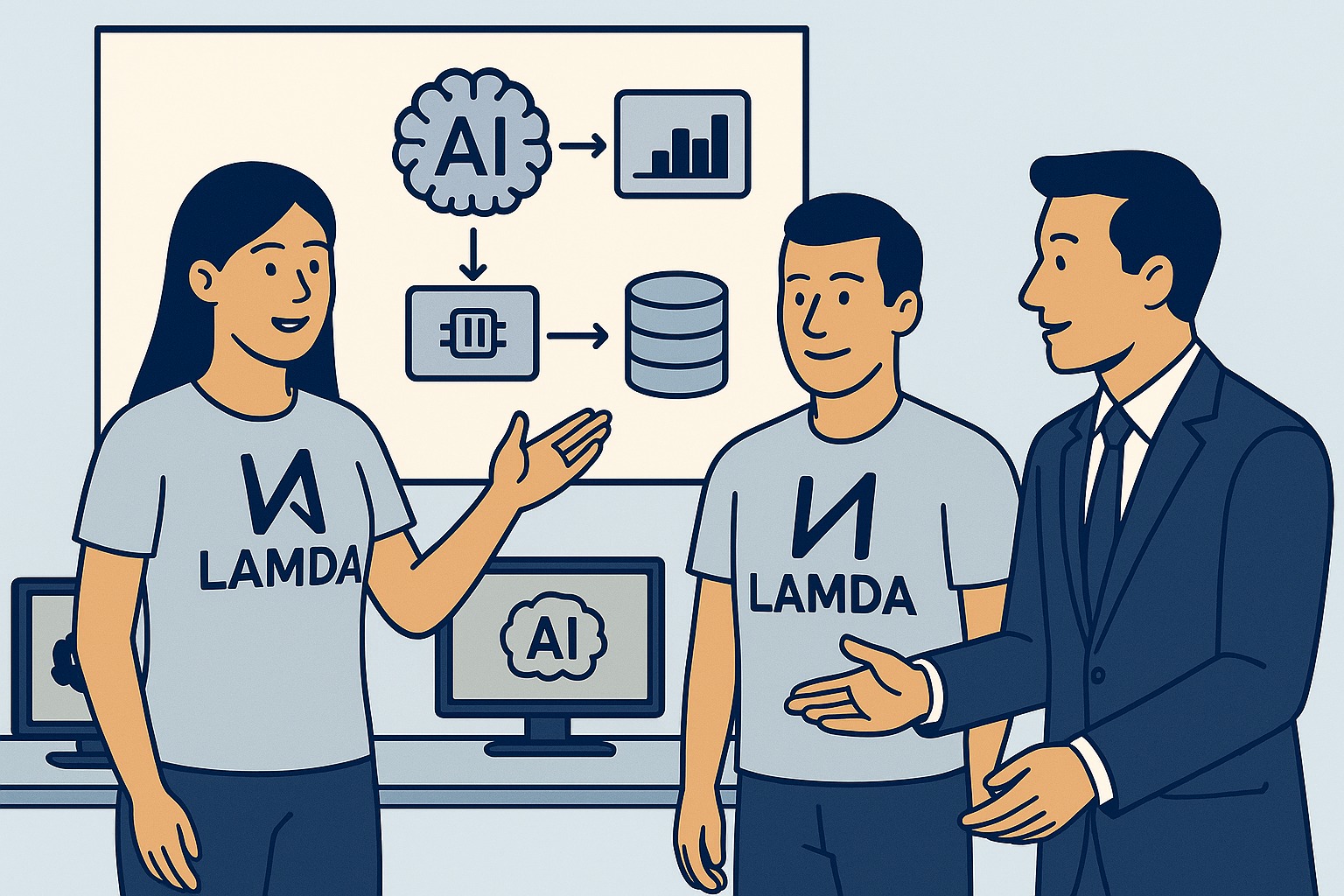

ביטוח AI עם LAMDA

- ניסיון עם מבטחים גלובליים – כולל סינדיקטים ב-Lloyd’s עם מוצרי AI ייעודיים

- התאמה מלאה לחוזי השקעה, לקוח וספק – כולל דרישות חוזיות מורכבות

- שילוב של אחריות מקצועית, סייבר ומוצר – לכיסוי הוליסטי

- הבנה עמוקה של תעשיית ההייטק וה-AI בישראל – כולל רגולציה, מימון וסיכון תפעולי